A notícia

A Austrália anunciou uma das legislações mais rigorosas já propostas sobre uso de redes sociais por menores. A medida pretende impedir que crianças e adolescentes com menos de 16 anos acessem plataformas como Instagram, TikTok, Facebook e Snapchat, exigindo que essas empresas adotem métodos de verificação de idade que vão desde documentos digitais até biometria e validação por instituições financeiras.

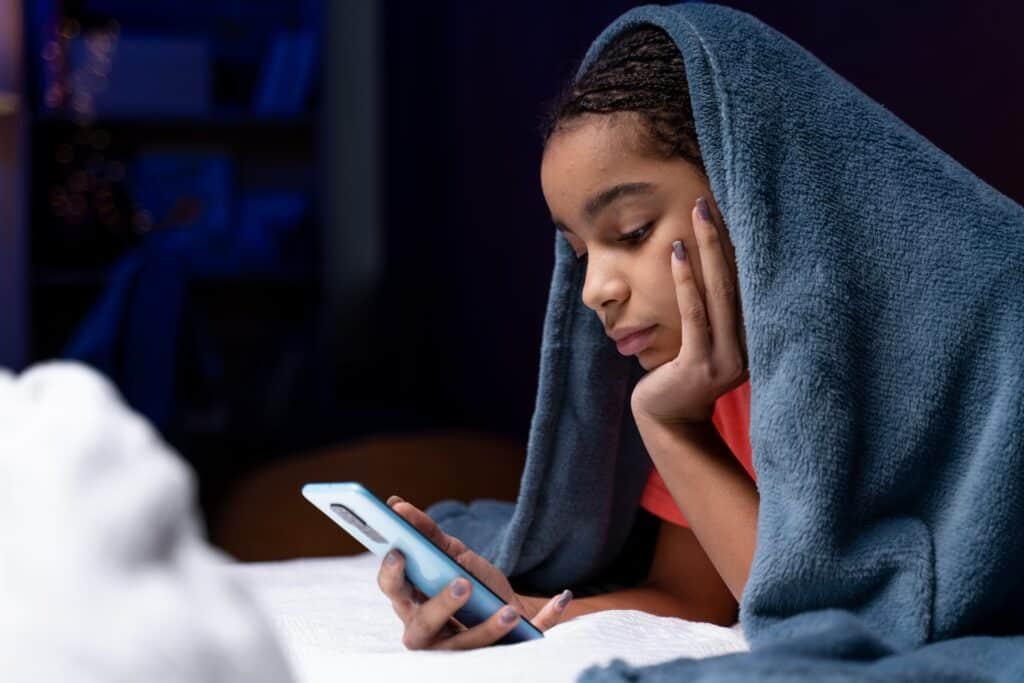

A justificativa é direta e apoiada em evidências. O governo argumenta que o ambiente digital, no modelo atual, expõe crianças a riscos significativos, como assédio, exploração sexual, manipulação algorítmica e impactos severos na saúde mental.

Mas a notícia é apenas a porta de entrada para uma discussão muito maior. Ela diz menos sobre a Austrália e mais sobre a fase histórica que estamos atravessando: a transição para uma sociedade que precisa decidir qual infância digital deseja construir.

Uma realidade que não pode ser ignorada

Os números demonstram que a conversa sobre proibição está descolada da realidade cotidiana. No Brasil, 92 por cento das crianças e adolescentes entre 9 e 17 anos usam a internet, o que representa mais de vinte e quatro milhões de jovens. Desses, 86 por cento têm perfil em redes sociais, apesar de muitas plataformas exigirem idade mínima superior. O celular é o dispositivo dominante para 98 por cento desse público [1][2][3].

Esses dados revelam que a infância e a adolescência já acontecem, em grande parte, dentro de ambientes digitais. Discutir apenas quem pode ou não entrar nesses espaços deixa de lado a questão essencial: como esses espaços são construídos e para quem.

O que os riscos realmente significam

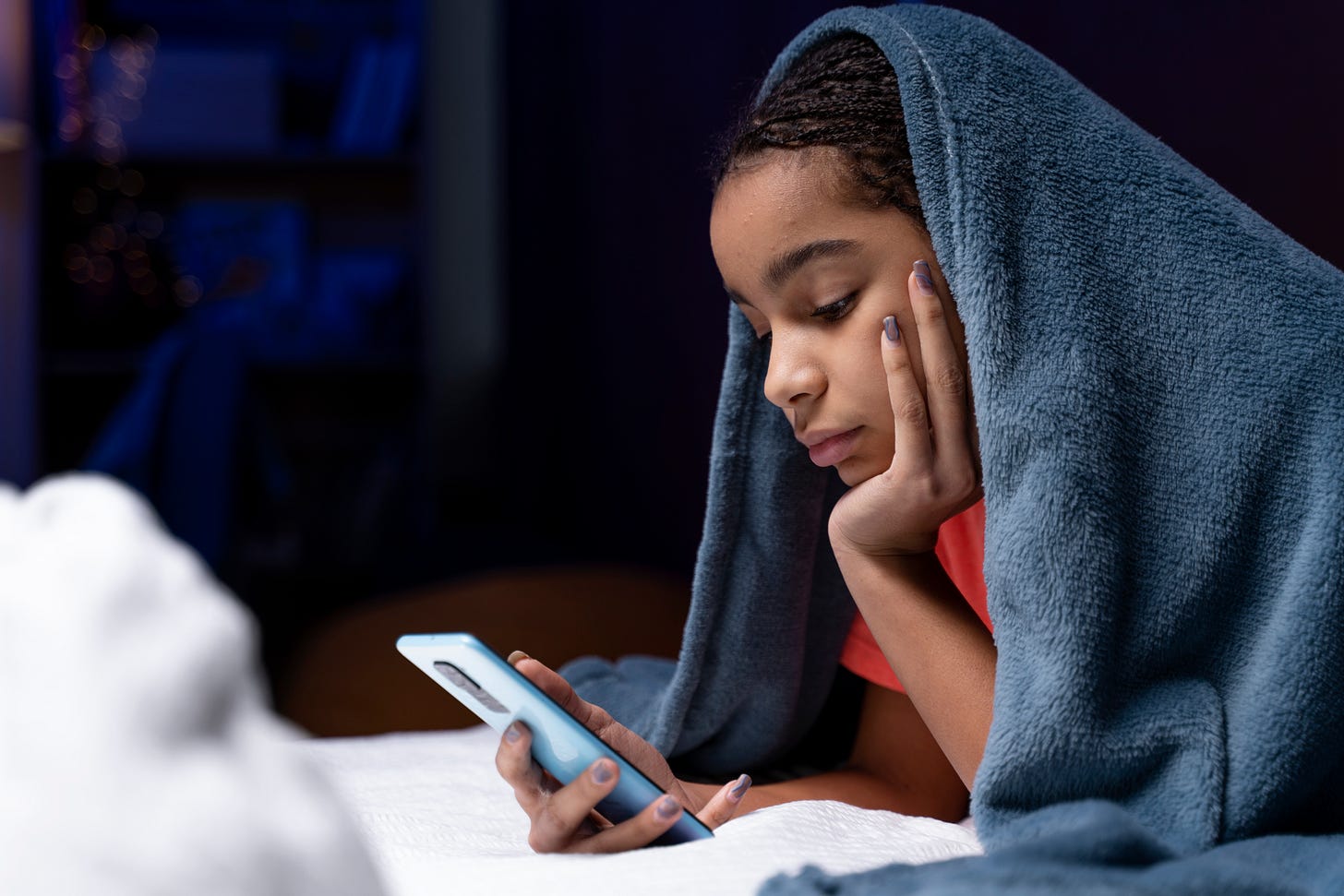

Diversos estudos mostram que o ambiente digital, no formato atual, não foi projetado para o desenvolvimento infantil. Em pesquisas globais, jovens relatam índices altos de cyberbullying, exposição a conteúdo violento, assédio e riscos de exploração sexual. Um em cada três adolescentes afirma ter sido vítima de bullying online ao menos uma vez [4][5].

No Brasil, quase um terço das crianças diz ter passado por alguma situação perturbadora na internet, enquanto apenas uma pequena fração dos pais acredita que isso tenha acontecido com seus filhos. Há uma desconexão de percepção entre gerações que torna o problema ainda mais complexo [6].

Além disso, relatórios internacionais apontam correlação entre uso intensivo de redes sociais e sintomas de ansiedade, depressão e piora na qualidade do sono entre adolescentes [7].

Esses dados mostram que existe um problema real, mas eles também deixam evidente que a raiz do problema não está apenas no acesso. Ela está no design, no modelo de negócio e na falta de governança ética das plataformas.

O artigo intitulado “Banning us from social media is ‘neither practical nor effective’, UK teenagers say” reúne depoimentos de jovens britânicos de 14 a 19 anos, que afirmam que uma proibição de acesso de menores não é solução. Entre os argumentos:

“Não devemos usar os recursos e o dinheiro dessas plataformas de mídia social para tentar evitar multas do nosso governo”, disse ele.

“Eles deveriam usar esse dinheiro e esses recursos para tentar se livrar dos predadores e do conteúdo prejudicial que existe por aí.”

Macy Newland, que está participando do desafio ao lado de Noah, admitiu acreditar que existem problemas com as redes sociais, jogos eletrônicos e tempo gasto em frente às telas em geral.

Mas ela disse à BBC que eles também trouxeram “muita coisa boa”, como educação, comunicação e inclusão na sociedade.

A Sra. Newland afirmou que, em vez de uma proibição geral, o que era necessário era uma melhor educação sobre os malefícios online, medidas de segurança reforçadas – como a verificação de idade – e recursos sobre como usar as redes sociais de forma adequada.

O casal argumenta que a proibição afetaria seus relacionamentos e, particularmente, suas fontes de conhecimento sobre política.

“A democracia não começa aos 16 anos, como diz esta lei”, afirmou a Sra. Newland.

O Digital Freedom Project (DFP), liderado pelo parlamentar de Nova Gales do Sul, John Ruddick, anunciou na quarta-feira que o processo foi aberto no Supremo Tribunal .

Muitos adolescentes reconhecem que a internet pode ser um ambiente hostil, mas rejeitam o caminho da exclusão. Para eles, o problema não é ter ou não ter acesso: é ter acesso em um ambiente regulado, moderado, responsável. Eles advogam por responsabilidade das plataformas, não por banimento.

Essa citação dá voz à parte impactada, não é só uma análise de adultos ou reguladores. Isso fortalece sua argumentação de que, se a infância digital tem valor social, o foco deve ser em moderação, design responsável e governança, não em proibição.

A resposta global e suas limitações

A Austrália adotou uma postura dura, mas outros países estão explorando caminhos diferentes. A União Europeia discute modelos de governança que responsabilizam plataformas pelo design e pela forma como algoritmos se comportam com diferentes faixas etárias. O Reino Unido já obriga empresas a demonstrar que seus sistemas reduzem riscos concretos para menores. Nos Estados Unidos, leis semelhantes foram barradas por conflitos constitucionais relacionados à liberdade de expressão.

Esse mosaico internacional mostra que o mundo concorda sobre o problema, mas não sobre a solução. A falta de consenso reflete a dificuldade de equilibrar privacidade, segurança, educação digital, acesso e responsabilidade corporativa.

O desafio invisível: desigualdade digital e verificação de idade

Embora a proteção seja necessária, a verificação rígida de idade traz consequências que raramente aparecem no debate público. A exigência de documentos digitais, biometria ou validação bancária exclui jovens que já vivem à margem do acesso digital. Muitas famílias brasileiras não têm documentos atualizados, não possuem acesso bancário ou usam dispositivos que não suportam tecnologias de verificação.

Isso cria um cenário em que jovens com mais recursos permanecem nas plataformas oficiais e mais seguras, enquanto jovens em situação de vulnerabilidade migram para ambientes menos regulados. Surge uma espécie de “dupla infância digital”: uma protegida, outra exposta.

Essa é uma das tensões éticas mais relevantes do debate e ainda pouco discutida.

Outro risco silencioso: deslocar o problema, não resolver

Proibir o uso de plataformas populares pode gerar um efeito colateral evidente. Crianças e adolescentes tendem a migrar para aplicativos paralelos com moderação reduzida, como chats anônimos, redes alternativas ou sistemas de troca de mensagens menos visíveis para autoridades e responsáveis.

Foi exatamente o que ocorreu quando algumas plataformas reforçaram moderação ou fecharam canais. Jovens simplesmente se deslocaram para espaços digitais com regras mais frágeis e maior risco de abuso.

Sem plataformas seguras e bem projetadas para cada faixa etária, a proibição tende a empurrar o problema para debaixo do tapete.

O cerne da discussão: o design das plataformas

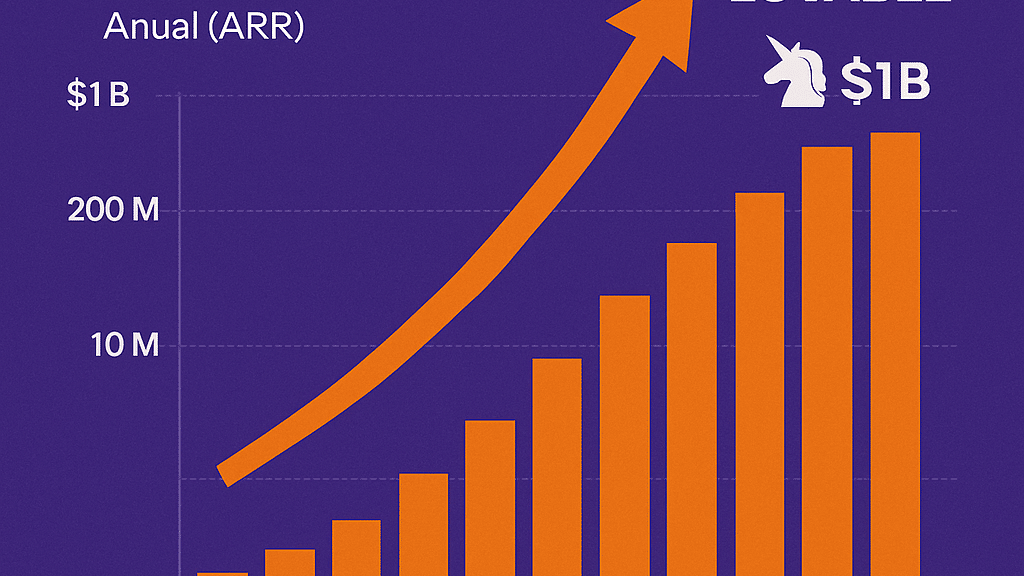

O modelo atual das grandes plataformas se apoia em mecanismos de engajamento contínuo. Quanto mais tempo o usuário permanece, mais valioso ele se torna para a empresa. Isso cria um ambiente que favorece recompensas rápidas, estímulos constantes e algoritmos voltados para capturar atenção, e não para promover bem-estar.

É difícil falar em proteção de crianças sem abordar essa estrutura. Mesmo com limitações de idade, moderação reforçada ou auditorias externas, enquanto o incentivo econômico continuar atrelado a engajamento, será difícil ver mudanças significativas.

Esse é o ponto que precisa ser colocado no centro da conversa.

Um caminho mais inteligente para a infância digital

Proibir o acesso pode parecer uma solução rápida, mas não resolve as causas estruturais do problema. Uma alternativa mais madura é pensar em plataformas desenhadas para diferentes idades, com algoritmos restritivos, menos estímulos, ferramentas de educação digital, limitações de mensagens diretas e padrões de moderação adequados ao desenvolvimento infantil.

É o que já acontece no mundo físico. Espaços públicos possuem regras distintas para crianças, adolescentes e adultos. Não isolamos jovens do convívio social, mas regulamos o tipo de interação possível. O mesmo deveria valer no ambiente digital.

Esse caminho exige tecnologia, ética e políticas públicas mais consistentes. Exige que empresas assumam responsabilidades reais. E exige que governos criem regulações capazes de fiscalizar, auditar e acompanhar o ecossistema tecnológico.

Conclusão

A decisão da Austrália é um marco, mas também um alerta. A infância digital não pode continuar existindo dentro de uma arquitetura pensada exclusivamente para adultos e otimizada para engajamento. É preciso discutir design, governança, desigualdade e propósito. Não se trata apenas de limitar o que jovens podem fazer online, mas de transformar o ambiente em que eles vivem.

A pergunta não é se devemos proibir. A pergunta é como queremos desenhar o futuro digital das próximas gerações.

Referências

[1] Cetic.br. TIC Kids Online Brasil 2024.

[2] NIC.br. 86% de crianças e adolescentes possuem perfil em redes sociais.

[3] Governo Federal do Brasil. Guia sobre uso de telas por crianças e adolescentes.

[4] UNICEF. Cyberbullying Study in 30 Countries.

[5] ONU. Child and Youth Safety Online.

[6] Senado Federal. Infomaterial sobre riscos digitais para crianças e adolescentes.

[7] UNICEF Innocenti. Childhood in a Digital World Report (2025).

Texto produzido em colaboração entre humano e inteligência artificial.